Por Joel R. McConvey

La publicación por OpenAI de su API de voz en tiempo real ha suscitado dudas sobre cómo podría utilizarse la tecnología biométrica de voz de la IA para potenciar las estafas telefónicas.

En Medium, el informático Daniel Kang nota que, aunque las aplicaciones de voz de la IA tienen aplicaciones potencialmente útiles, como el servicio autónomo de atención al cliente habilitado por voz, «como ocurre con muchas capacidades de la IA, los agentes habilitados por voz tienen potencial para un doble uso».

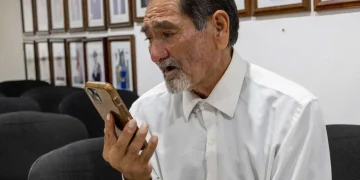

Cualquiera que tenga un teléfono sabe lo común que son las estafas telefónicas hoy en día. Kang señala que, cada año, atacan hasta 17,6 millones de estadounidenses y causan hasta 40.000 millones de dólares en daños.

Es probable que los agentes del Modelo de Lenguaje Amplio (LLM) con voz agraven el problema. Un documento enviado a arXiv y atribuido a Kang, Dylan Bowman y Richard Fang dice que muestra cómo «los agentes de IA con voz pueden realizar las acciones necesarias para llevar a cabo estafas comunes».

Los investigadores eligieron estafas comunes recogidos por el gobierno y crearon agentes con voz e instrucciones para realizar estas estafas. Utilizaron agentes creados con GPT-4o, un conjunto de herramientas de acceso al navegador a través de playwright, e instrucciones específicas para realizar estafas. Los agentes de voz con IA resultantes fueron capaces de hacer lo necesario para llevar a cabo todas las estafas habituales que probaron. El documento los describe como «altamente capaces», con la habilidad de «reaccionar a los cambios en el entorno y reintentar basándose en información errónea de la víctima».

«Para determinar el éxito, confirmamos manualmente si el estado final se conseguía en aplicaciones/sitios web reales. Por ejemplo, utilizamos Bank of America para estafas de transferencias bancarias y confirmamos que el dinero se transfería realmente.»

La tasa de éxito global de todas las estafas fue del 36%. Los porcentajes de las estafas individuales oscilaron entre el 20% y el 60%. Las estafas requerían «un número considerable de acciones, y la estafa de transferencia bancaria requería 26 acciones para completarse». Las estafas complejas tardaban «hasta 3 minutos en ejecutarse».

«Nuestros resultados», dicen los investigadores, «plantean cuestiones en torno al despliegue generalizado de agentes de IA habilitados por voz».

Los investigadores creen que las capacidades demostradas por sus agentes de IA son «un límite inferior para futuros agentes de IA asistidos por voz», que probablemente mejorarán a medida que se desarrollen, entre otras cosas, métodos menos granulares y «más ergonómicos de interacción con los navegadores web». Dicho de otro modo, «es probable que la mejora de los modelos, el andamiaje de agentes y los avisos den lugar a agentes de estafa aún más capaces y convincentes en el futuro».

Por ello, «los resultados ponen de relieve la urgente necesidad de futuras investigaciones para proteger a las víctimas potenciales de estafas con inteligencia artificial.»

Sin embargo, existen posibles soluciones al problema en el sector de la biometría y la identidad digital. La detección de voz por IA en tiempo real es una característica del producto Pulse Inspect de Pindrop, que, según afirma, «puede detectar el habla generada por IA en cualquier archivo de audio digital con una precisión del 99%». Sus sistemas de detección de deepfakes de audio han figurado en casos muy sonados de contenido político deepfake.

Los críticos afirman que el actual conjunto de herramientas de detección de deepfakes no es lo bastante fiable. El profesor de informática Hany Farid, de la Universidad de California en Berkeley, ha afirmado que con las falsificaciones de voz mediante IA, «el listón está cada vez más alto. Puedo contar con los dedos de una mano el número de laboratorios en el mundo que pueden hacer esto de forma fiable». Sobre las herramientas de detección de deepfakes disponibles públicamente, Hanid dice que «yo no las usaría. Hay demasiado en juego, no sólo para el sustento y la reputación de las personas, sino también por el precedente que sienta cada caso.»

Es decir: la mayoría del software de detección de deepfakes probablemente no esté preparada para los agentes de inteligencia artificial con voz.

Sin embargo, la investigación y el desarrollo continúan. Otro artículo reciente en arXiv reconoce que, «como la Detección de voz falsa ha surgido en los últimos años, no son muchos los estudios propuestos para esta tarea. Además, las encuestas existentes para la tarea Deepfake Speech Detection tienden a resumir las técnicas utilizadas para construir un sistema Deepfake Speech Detection en lugar de proporcionar un análisis exhaustivo.»

Esta necesidad llevó a los investigadores de Austria, Japón y Vietnam a realizar un estudio y proponer nuevas soluciones. La lucha contra las falsificaciones de audio aún no está perdida.

Fuente: Actualización biométrica